投稿 LLMO(大規模言語モデル最適化)とは?GEOやSEOとの違いやAI時代の流入戦略を徹底解説! は ITreview Labo に最初に表示されました。

]]>近年、生成AI技術の革新にともない、ChatGPTやPerplexityなどのAI検索が台頭するなか、多くの企業で、従来型のSEO手法から新しいLLMOへの流入戦略の転換が大きな注目を集めています。

しかし、LLMOには明確な定義の曖昧さや最適化方法の未知性といった課題も多く、誤った運用によっては、AIに取り上げられないリスクも存在します。

本記事では、LLMOにおける基本的な考え方やSEOとの違いの解説に加えて、重要視される理由やメリット・デメリットまで徹底解説していきます。

この記事を読むだけで、LLMOの全体像と実践方法がまるごと理解できるため、AI時代の新しい流入施策に悩んでいる担当者には必見の内容です!

LLMO(大規模言語モデル最適化)とは?

LLMO(大規模言語モデル最適化)とは、英語の「Large Language Model Optimization」の頭文字を取った略語で、生成AIが出力する回答に自社のサイトや製品を表示させる最適化戦略のことです。

従来のSEOとは異なり、LLMOではChatGPTやGeminiなどの各種AIが生成した回答に、自社のコンテンツが引用されることで、SEOだけに依存しない間接的な流入経路を獲得することができます。

また、生成AIやAI検索に対する最適化の概念は、LLMOのほかにも「GEO(Generative Engine Optimization)」や「AEO(Answer Engine Optimization)」といった似た概念が存在します。

BtoBビジネスの領域においては、従来までのGoogle検索よりも、AIを使った情報収集活動が活発化しているため、今後はLLMOによるAI対策が重要な役割を果たすとして注目を集めています。

LLM(大規模言語モデル)とは?

| モデル名 | 開発企業 | 主な特徴 |

|---|---|---|

| ChatGPT (チャットジーピーティー) | OpenAI | 高度な推論能力とタスク対応 |

| Claude (クロード) | Anthropic | 長文対話と自然な言語出力 |

| Gemini (ジェミニ) | マルチモーダル対応 | |

| LLaMA (ラマ) | Meta | オープンソース展開 |

| DeepSeek (ディープシーク) | DeepSeek AI | マルチモーダル対応 |

LLM(Large Language Model)とは、膨大なテキストデータを学習して、自然言語(私たちが普段使用する言葉)による理解と回答の生成を行うタイプの人工知能モデルのことです。

LLMにもよって異なりますが、およそ数十億から数兆個のパラメータを持つ、ニューラルネットワークの採用によって人間に近い文章理解力と回答生成能力を実現しています。

LLM以外の生成エンジン

| モデル名 | 開発企業 | 主な特徴 |

|---|---|---|

| Google AI Overviews | Google検索結果の上部に出現 | |

| Perplexity | Perplexity AI | 高度なリアルタイム検索と推論 |

| Copilot | Microsoft | Office365と連携したデータ分析 |

対して、上記の生成AIサービスは、厳密にはLLMではありません。ChatGPTをはじめとするLLMを使用した「生成エンジン(AI駆動型検索エンジン)」として区別されています。

そして、これらの生成エンジンに対して最適化の施策を施すのが、本来「GEO(生成エンジン最適化)」と呼ばれる概念になるのですが、現状どちらも同じ意味で使われています。

いずれも最近になって使われ始めた新しい概念であり、現時点ではどの言葉が業界標準として定着するかは明確になっていないため、ほとんど同義として扱って問題ないでしょう。

LLMOが重要視される3つの理由

- AIOが大きな影響力を持つようになった

- ユーザー自身の検索行動に変化が生じた

- 従来までのSEO流入は減少の傾向にある

AIOが大きな影響力を持つようになった

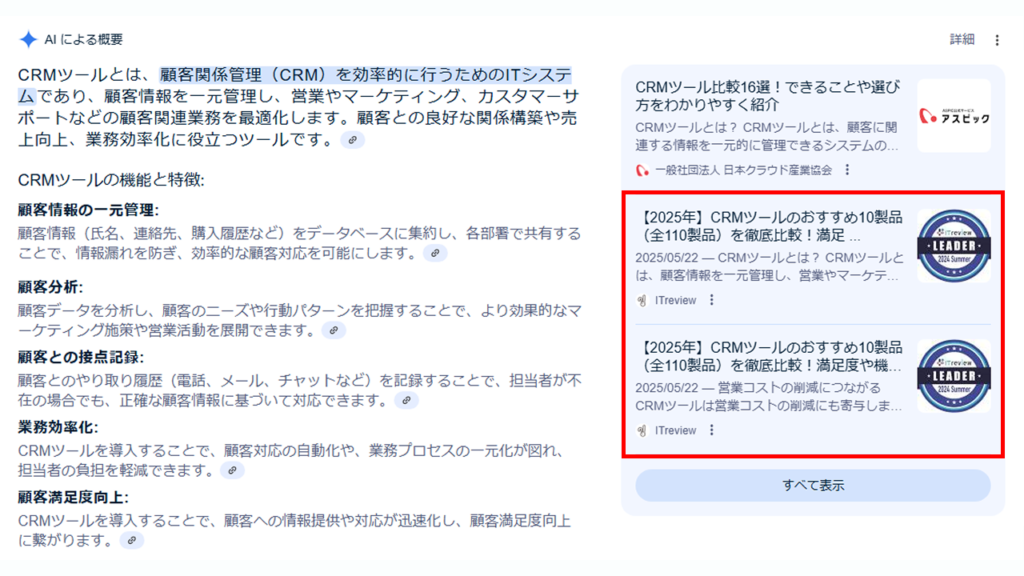

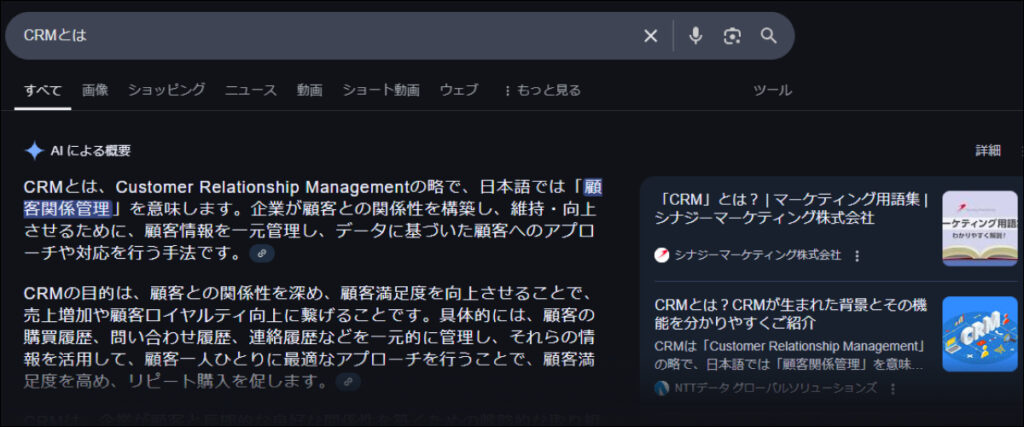

LLMOが注目されるようになった理由の1つ目としては「AIOが大きな影響力を持つようになった」というものが挙げられます。

AIO(AI Overviews)とは、Googleが導入を進めている生成AIを用いた検索要約機能のことであり、2024年8月にテストリリースされて以降、ユーザーの検索体験そのものに大きな影響を与えています。

AIOの特徴としては、広告枠である「スポンサー」や既存の引用機能である「強調スニペット」よりも上部に位置していることで、事実上の検索1位をGoogle自身のAIが独占する構図となっています。

このような変化においては、従来のSEOだけでは自社の順位が相対的に下落してしまうため、AIOに引用されやすい構造と、信頼性を兼ね備えたLLMOの重要性が急速に高まっているというわけです。

ユーザー自身の検索行動に変化が生じた

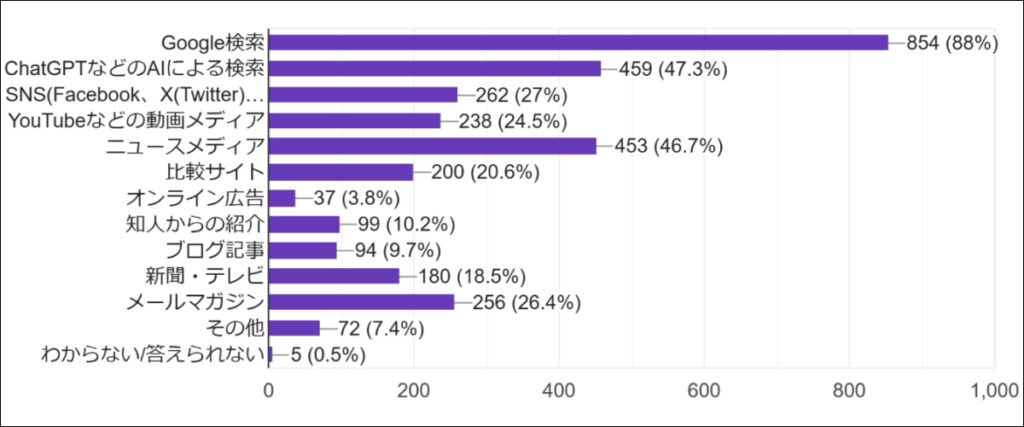

LLMOが注目されるようになった理由の2つ目としては「ユーザー自身の検索行動に変化が生じた」というものが挙げられます。

従来までは、Google検索にキーワードを入力して情報を探す行動パターンが主流でしたが、近年ではChatGPTやPerplexityといった、生成AIを使った対話形式の情報収集が急速な広がりを見せています。

実際に、ITreviewの行った『ビジネスにおける情報収集媒体に関する意識調査アンケート』によると、ビジネス情報の収集においては、約半数のユーザーがAIを活用しているという結果も報告されました。

こうしたユーザー自身の検索行動の変化により、検索エンジン以外の経路から情報が届けられるケースが増加しているため、従来までのSEO対策ではカバーしきれない領域が拡大しているというわけです。

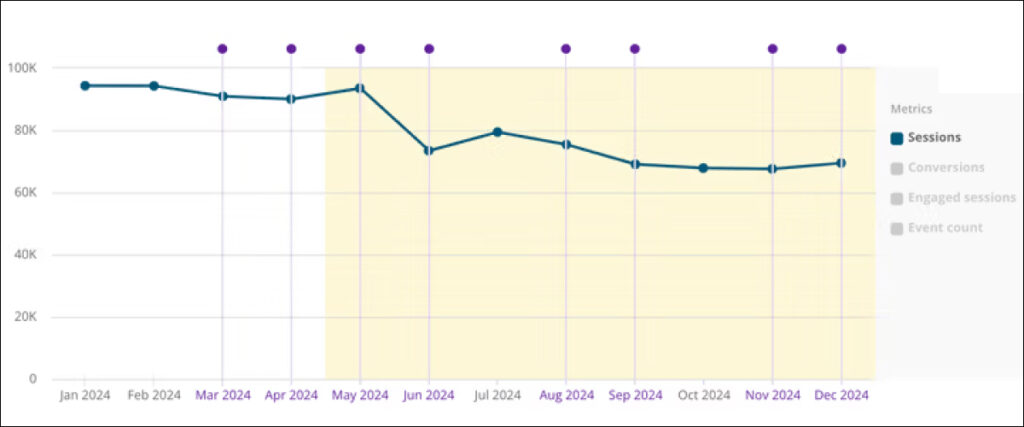

従来までのSEO流入は減少の傾向にある

LLMOが注目されるようになった理由の3つ目としては「従来までのSEO流入は減少の傾向にある」というものが挙げられます。

従来までのSEO手法は、Google検索からのオーガニック流入を増やすための効果的な手段として長年君臨し続けてきましたが、近年ではその効果に陰りが見え始めていることもまた事実です。

実際に、SEOの本場である米国Conductor社のレポートによると、AIOが実装されて以降、一部のページにおけるオーガニックトラフィックが、最大60%も減少しているという事例も報告されています。

度重なるアップデートにより、検索結果の上部にはリスティングや強調スニペット、さらにはAIOが表示されるようになったことで、上位表示の価値そのものが以前よりも低下していると考えられます。

LLMOとSEOの違い

| 項目 | LLMO | SEO |

|---|---|---|

| 対策対象 | 生成AI | 検索エンジン |

| 流入経路 | 生成AIチャット経由 | オーガニック検索経由 |

| 実施目的 | 生成AIの回答に引用される | 検索結果で上位に表示される |

| 効果測定 | 引用箇所のトラッキングが難しい | 検索順位などから一定の測定は可能 |

| 主な評価軸 | 構造化データ 情報の信頼性 文脈の一貫性 出典元の明示 など |

ドメインパワー キーワードの最適化 PVやセッション数 被リンクの量や質 など |

| 主な対応策 | FAQ形式の見出し構造 明確なソースの提示 簡潔な文章表現 など |

キーワードの配置 タイトルの最適化 内部リンクの設置 など |

LLMOとSEOの共通点

LLMOとSEOの共通点としては「どちらも流入の最大化が目的である」という点が挙げられます。

いくらAI検索のニーズが高まっているとはいえ、どちらもユーザーが求める情報に最短距離でたどり着けるようにすることが目的であり、情報の信頼性や見出し構造の整理といった、コンテンツ全体の品質向上こそが両者の基本的な施策軸となります。

具体的には、信頼性の高い情報発信、明確な見出し設計、関連性のあるコンテンツ群の構築といった点が重要であり、LLMOもSEOも重視する評価基準に大きな違いはないといえます。

このように、対象は異なっていても「ユーザーの質問やニーズに応えるための情報の最適化」という根本の思想は共通しており、SEOで培ったナレッジや制作ノウハウを応用できることは大きな強みです。

LLMOとSEOの相違点

LLMOとSEOの相違点としては「そもそもの最適化の対象が異なる」という点が挙げられます。

SEOはGoogleやBingなどの検索エンジンアルゴリズムに最適化する手法であるのに対して、LLMOはChatGPTやGeminiなどの生成AIに情報を引用されやすくするための最適化手法であるため、コンテンツの設計やアプローチにも大きな差異が生じます。

この違いにより、SEOではキーワードの出現率や被リンクなどが重視されるのに対し、LLMOでは文脈の一貫性や信頼性など、より構造的なコンテンツが重視される傾向にあります。

つまり、SEOは「検索結果で見つけてもらう」施策であり、LLMOは「AIが出力する回答に引用される」施策であるため、従来のSEOではカバーしきれない領域に対してはLLMO独自の戦略設計が重要です。

LLMOとGEOの違い

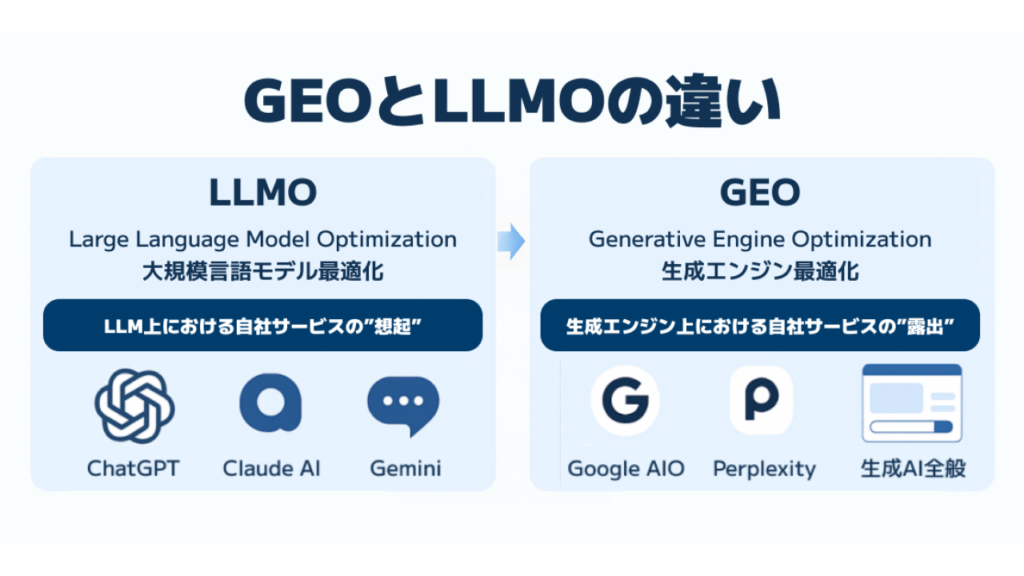

LLMOと似た概念として「GEO(Generative Engine Optimization:生成エンジン最適化)」という概念が存在します。

一見すると非常に違いがわかりにくい両者ですが、結論としては「LLMOとGEOは互いに異なる概念ではあるものの、具体的な対策手法や考え方に大きな違いはない」ということです。

どちらも新しい概念であるため、両者に明確な定義があるわけではありません。各種AIに自社の情報が引用・想起されやすくするための包括戦略という点では共通した概念といえるでしょう。

LLMOの意味・特徴

LLMOは「LLMが回答を出力する際、自社のサービスを想起してもらえるようにする戦略」を指すもので、具体的には「○○といえば?という質問に対して対象を連想させること」を目的としています。

対象範囲は、ChatGPTやGeminiといった大規模言語モデルの範囲に限定されており、対話形式で回答を生成するAIチャットに焦点を当てた最適化戦略ともいえるでしょう。

GEOの意味・特徴

GEOは「生成AIが回答を出力する際、自社のサービスを回答として出力してもらうための戦略」を指すもので、具体的には「検索結果の画面上に自社のサービスが露出すること」を目的としています。

対象範囲は、Google AI OverviewsやPerplexityといったLLM以外の生成AIも含んでおり、生成エンジンと呼ばれるAIシステム全般に焦点を当てた最適化戦略ともいえるでしょう。

LLMOの実施によるメリット

- AI経由での流入チャネルを獲得できる

- 指名検索やブランド認知を促進できる

- 検索アルゴリズムの影響を受けにくい

AI経由での流入チャネルを獲得できる

LLMOのメリットの1つ目としては「AI経由での流入チャネルを獲得できる」という点が挙げられます。

ChatGPTやGeminiなどのAIチャット、もしくはAIOといった生成AIに自社の情報が引用されることによって、これまで主流だった検索エンジン以外からの流入を獲得できる可能性が広がります。

特に、ゼロクリック検索が増加する現代SEOにおいては、ユーザーが検索結果をクリックせずに情報を取得する傾向が強まっており、AIに言及されることが新たな接点の創出につながります。

特定のジャンルにおいて「いつもAIに引用されているサイト」としてユーザーに認知させることができれば、検索エンジンに依存せずに流入や権威性の獲得を期待することができるでしょう。

指名検索やブランド認知を促進できる

LLMOのメリットの2つ目としては「指名検索やブランド認知を促進できる」という点が挙げられます。

生成AIが出力する回答に、自社のサービス名や製品名が繰り返し引用されることで、ユーザーの記憶に残りやすくなり、単純接触効果によってブランドの想起を強化する効果が期待できます。

特にBtoB領域では、購入から契約までの意思決定プロセスが長期化する傾向があるため、聞いたことのないサービスや無名の製品は、そもそも検討の土台にすら上らないことも多くあります。

生成AIの出力する回答に引用されることにより、後日の指名検索やリードの獲得にもつながるため、ナーチャリングチャネルとしてのAI活用は、今後ますます重要な戦略となることでしょう。

検索アルゴリズムの影響を受けにくい

LLMOのメリットの3つ目としては「検索アルゴリズムの影響を受けにくい」という点が挙げられます。

Google検索におけるコアアップデートは順位に大きな影響を与える一方、生成AIは検索アルゴリズムとは異なるロジックで回答を生成するため、ロジック変更による影響は少ないといえます。

そのため、中長期的に安定した情報露出を維持する施策として活用することができ、SEOと比較しても短期的な順位変動のリスクが少ないということは、LLMOの大きなメリットのひとつです。

ただし、生成AIが検索エンジンの順位やトラフィックを全く参考にしていないかと言うと、決してそうともいえないため、あくまでも「影響は少ない」程度の理解にとどめておくべきでしょう。

LLMOの実施によるデメリット

- 引用される保証がない

- 施策の効果測定が難しい

- 仕様変更の影響を受ける

引用される保証がない

LLMOのデメリットの1つ目としては「引用される保証がない」という点が挙げられます。

どれだけコンテンツに最適化を施したとしても、現時点で生成AIがどのような情報を引用するのかはブラックボックスであり、必ずしも意図した通りの成果が得られるとは限りません。

また、AIが情報源として扱う範囲や優先順位も日々変化しているため、仮に一度引用された場合であっても、将来的には除外されるリスクがあるということは留意する必要があります。

そのため、安定した成果を求める場合には、LLMO単体にリソースの全てを投入するのではなく、既存のSEOやSNS戦略、広告施策などとも組み合わせたハイブリッドな戦略が望まれます。

施策の効果測定が難しい

LLMOのデメリットの2つ目としては「施策の効果測定が難しい」という点が挙げられます。

近年の生成AIチャットには、回答文内に情報ソースのリンクを明示するサービスもありますが、必ずしも全ての回答に引用リンクが付与されるわけではなく、可視性にはバラつきがあります。

また、AIがどのような基準で情報を引用しているかはブラックボックスであり、明確な指標やトラッキング方法も存在しないため、SEOのように直接的な効果を測定するのが難しい状況です。

実際にLLMO施策が有効だったかどうかを判断するには、指名検索の増減やナビゲーションクエリの傾向、SNSでの言及数など、より間接的なデータを複合的に評価する必要があるでしょう。

仕様変更の影響を受ける

LLMOのデメリットの3つ目としては「仕様変更の影響を受ける」という点が挙げられます。

ChatGPTやGeminiなどの生成AIは、内部のロジック変更やアルゴリズムのアップデートなどにより、回答の形式や情報参照先の優先順位が頻繁に変更される傾向にあるため、注意が必要です。

例えば、一定期間うまくAIに引用されていたコンテンツであっても、仕様変更の直後から突然表示されなくなったというケースもあるため、そうしたリスクは想定しておかなければなりません。

このようなリスクに対応するためにも、継続的なモニタリングと改善サイクルを組み込みながら運用することはもちろん、SEOやSNS戦略などのマルチな施策の展開が重要になってきます。

LLMOの具体的な対策方法

- ①:コンテンツ対策

- ②:テクニカル対策

- ③:E-E-A-T対策

①:コンテンツ対策

| 項目 | 内容 |

|---|---|

| コンテンツ品質の向上 | インフォグラフィックスの追加やファクトチェックを実施する |

| 文章構成の見直し | Q&A型やPREP法などでAIが理解しやすい文章構成に修正する |

| 情報更新性の担保 | 更新性や時事性の高いコンテンツの情報は定期的に更新する |

| 調査レポートの発信 | 独自の調査データやレポートコンテンツを定期的に発信する |

LLMOにおけるコンテンツ対策は、大規模言語モデルが学習・参照したくなるような、高品質なコンテンツを制作することが重要です。

特に、Q&A型やPREP法を用いたAIが理解しやすい文章構成は、専門的な知識が不要かつ今日から実施できる即効性の高い施策であるため、優先度を高めて取り組んでいきたい施策といえるでしょう。

②:テクニカル対策

| 項目 | 内容 |

|---|---|

| llms.txtの設置 | llms.txt(LLMに向けたサイト情報提供ファイル)を設置する |

| robots.txtの対応 | robots.txtに主要なAIクローラーのクロール可否を明示する |

| 構造化データの実装 | JSON-LD形式で構造化データを適切にマークアップする |

| 適切なmetaタグの実装 | タグ内にページを説明する適切な情報やキーワードを入れる |

LLMOにおけるテクニカル対策は、AIクローラーがサイト情報を正確に理解し、効率的に情報収集できる基盤を整備することが重要です。

特に、JSON-LD形式での構造化データの実装やllms.txtの設置などは、LLMOにおいては基礎的な対策手法として知られているため、可及的すみやかに展開しておきたい施策といえるでしょう。

③:E-E-A-T対策

| 項目 | 内容 |

|---|---|

| Experience (経験値) | 実際の事例や実践的な知見を発信する |

| Expertise (専門性) | 業界エキスパートによる監修を付ける |

| Authoritativeness (権威性) | 公的機関データや論文等から引用する |

| Trustworthiness (信頼性) | 定期的な情報更新と訂正体制を整える |

大規模言語モデルは、高品質なコンテンツを優先的に学習データとして活用するため、信頼性の高い情報発信と権威性の獲得が不可欠です。

例えば、関連する権威性の高いメディアに継続的に露出したり、SNS上で自社ブランドのユーザーと関係構築を図ったりなど、SEOやLLMOだけにとどまらない広範な認知獲得がポイントとなるでしょう。

まとめ

本記事では、LLMOにおける基本的な考え方やSEOとの違いの解説に加えて、重要視される理由やメリット・デメリットまで徹底解説していきました。

LLMO施策の展開により、AIの回答に引用されやすい構造や情報形式を整備できるため、SEOだけでは届かなかったAI検索からの認知や流入の獲得を狙えるようになります。

ユーザーの検索行動が変化しつつある昨今、AIOの実装範囲が広がるにつれて、LLMO施策の有無が新たな流入チャネルの差別化要因になることは確実であるといえるでしょう。

ただし、SEOにしろLLMOにしろ、どちらもユーザーが求める情報に、最短距離でたどり着けるようにするという目的は共通しています。

そのため、検索アルゴリズムやAIに踊らされるのではなく、真にユーザーの役に立つコンテンツとは何かを追求していく姿勢が重要です。

投稿 LLMO(大規模言語モデル最適化)とは?GEOやSEOとの違いやAI時代の流入戦略を徹底解説! は ITreview Labo に最初に表示されました。

]]>